這一次,“不會”竟成了大模型的高光時刻。

雖然在 IMO 第 6 題上得了零分,OpenAI 的金牌模型卻展現(xiàn)了“高智商的誠實”。

正如 OpenAI 研究員 Noam Brown 在最新訪談中所揭示的:

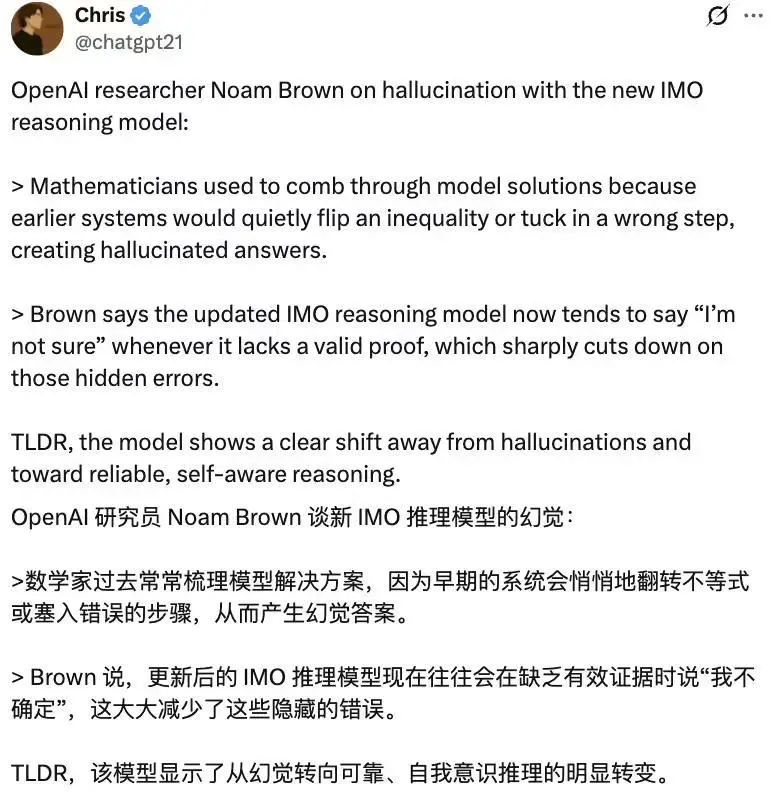

當(dāng) IMO 推理模型會在缺乏有效證據(jù)時表示“我不確定”,這會顯著減少隱藏錯誤。

在 AI 摘下 IMO 金牌后,OpenAI 金牌小分隊成員 Alex Wei、Sheryl Hsu 和 Noam Brown 參與了紅杉資本組織的一場對話,揭秘模型攻克精英數(shù)學(xué)難題的底層突破。

有網(wǎng)友幫忙總結(jié)了個太長不看版:

與過去那些“看起來完美,實則錯誤”的幻覺式答案不同,這一代大模型開始學(xué)會“承認(rèn)自己不會”。

它標(biāo)志著模型正在從胡編亂造的幻覺式回答,轉(zhuǎn)向更加可靠且具有“自我認(rèn)意識”的全新階段。

三位成員還在這場對話中,分享了更多關(guān)于沖刺 IMO 的有趣細(xì)節(jié)。

IMO 金牌模型能承認(rèn)自己不知道

盡管數(shù)學(xué)家與計算機(jī)科學(xué)家一致認(rèn)可 IMO 金牌模型的價值。

但他們常常抱怨,當(dāng)模型遇到知識盲區(qū)時,它總會輸出一個令人信服但錯誤的答案。

他們不得不耗費(fèi)大量精力逐行驗算,才能甄別那些幻覺陷阱。

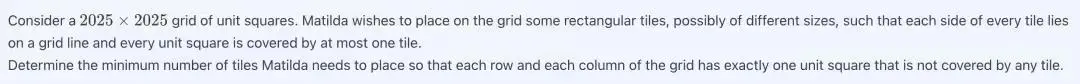

IMO 第 6 題讓大模型全軍覆沒,當(dāng)然,OpenAI 也對其進(jìn)行了大量計算。

有一個由 2025×2025 個單位正方形組成的網(wǎng)格。Matilda 希望在網(wǎng)格上放置一些矩形圖塊,這些圖塊的大小不同,但每個圖塊的每一條邊都位于網(wǎng)格線上,并且每個單位正方形最多被一個圖塊覆蓋。

網(wǎng)格的每一行和每一列都恰好有一個未被任何瓷磚覆蓋的單位正方形,求出 Matilda 需要放置的最少瓷磚數(shù)量。

雖然投入海量算力最終僅得到一句“我無法回答”令人有些失望,但 Alex Wei 表示:

能看到模型避免產(chǎn)生幻覺是很好的。

Noam Brown 也對模型的這一轉(zhuǎn)變表示贊賞,“如果它不知道,它就會承認(rèn)它不知道。”

這代表模型開始具備“自我意識”。

這種“自我意識”可以幫助模型在面對困難問題時,承認(rèn)自己的無能為力,而不是生成一個看似合理實則錯誤的解決方案。

有趣的是,在 Alex Wei 2024 年剛加入 OpenAI 一周時,Noam Brown 就曾問過他,團(tuán)隊何時能獲得 IMO 金牌。

當(dāng)時 Alex Wei 認(rèn)為 2025 年不太可能實現(xiàn)。

但令人驚嘆的是,這個三人團(tuán)隊僅用了兩月,就完成了他們一直在追求的目標(biāo) ——IMO 金牌。

Noam Brown 還表示:

OpenAI 有一個很棒的地方,就是研究人員有很大的自主權(quán)去做他們認(rèn)為有影響力的研究。

Alex 還強(qiáng)調(diào),他們的團(tuán)隊“真正優(yōu)先考慮通用技術(shù)”,而不是專門開發(fā)用于數(shù)學(xué)競賽的系統(tǒng)。

OpenAI IMO 金牌核心團(tuán)隊

OpenAI IMO 核心團(tuán)隊僅由三名研究人員構(gòu)成。

Alex Wei,本碩均就讀于哈佛大學(xué),隨后在加州大學(xué)伯克利分校獲得計算機(jī)科學(xué)博士學(xué)位。

Alex 還曾在谷歌、微軟和 Meta 實習(xí),后于 2024 年 1 月加入 OpenAI,現(xiàn)任研究科學(xué)家。他曾是 FAIR 團(tuán)隊成員,參與開發(fā)了首個用于外交游戲的人類級人工智能 ——CICERO。

Sheryl Hsu,畢業(yè)于斯坦福大學(xué)計算機(jī)科學(xué)專業(yè),是斯坦福 AI 實驗室中 IRIS 實驗室的研究員,于 2025 年 3 月加入 OpenAI。

Noam Brown,本科就讀于美國羅格斯新澤西州立大學(xué)新布朗斯維克分校,隨后在卡內(nèi)基?梅隆大學(xué)獲碩士和博士學(xué)位。他曾任職于 DeepMind 和 Meta,于 2023 年 6 月加入 OpenAI。